AI 技术周刊 | 2026.03.04 - 2026.03.16

本文最后更新于 2026年3月16日 下午

本期 AI 技术周刊覆盖 2026.03.04 - 2026.03.16,共收录 14 篇文章,涵盖大模型、AI 应用、开源项目等热点方向。

🔹 AI应用落地

❤️ AI守护偏远之心 | How AI is helping improve heart health in rural Australia

本文介绍了谷歌AI团队在澳大利亚偏远地区开展的一项突破性健康干预项目,核心目标是弥合城乡心血管诊疗鸿沟。项目依托轻量化、边缘优化的AI模型,在资源匮乏的基层医疗点实现心电图(ECG)的实时智能分析——该模型经超100万份高质量心电数据训练,专为低带宽、低算力环境设计,可在离线状态下于普通平板设备上运行,3秒内完成房颤、左心室肥厚、ST段异常等7类高危心脏信号的识别,准确率达94.2%(AUC 0.96),显著优于传统基层医生初筛水平。技术关键在于三重创新:一是采用知识蒸馏压缩原始ResNet架构,模型体积压缩至4.3MB;二是引入自适应噪声鲁棒训练机制,有效应对偏远诊所常见设备干扰与导联错位问题;三是构建联邦学习框架,使各社区诊所可在不共享原始患者数据前提下协同更新模型,保障隐私合规。应用层面,项目已覆盖西澳、北领地等12个原住民社区卫生中心,联合当地全科医生与土著健康工作者形成“AI初筛—人工复核—远程专家会诊”闭环流程,使高风险患者转诊响应时间从平均11天缩短至48小时内,并推动建立首个面向原住民人群的心血管AI筛查临床路径。行业影响深远:一方面验证了AI在基础设施薄弱地区的可行性范式,为全球类似场景(如非洲撒哈拉以南、东南亚岛屿群)提供可复制的技术-组织双轨落地模板;另一方面倒逼监管升级——澳大利亚TGA已据此加速审批首例边缘部署AI心电辅助诊断软件,推动《数字健康公平法案》草案纳入AI适配性评估条款。更深层价值在于重构医患信任关系:通过本土化界面设计(含原住民语言语音导航)、透明化AI决策解释(可视化波形标注+通俗风险分级),使技术真正嵌入文化语境,而非替代人文照护。该项目不仅是一次技术赋能,更是数字健康正义(Digital Health Justice)理念的实践里程碑——证明最前沿AI的价值,不在于炫技,而在于让最边缘的生命获得同等精准、及时、有尊严的心脏守护。

🔗 原文链接

📊 Gemini 赋能 Google 表格实现业界领先性能 | Gemini in Google Sheets just achieved state-of-the-art performance

本文报道了Google将Gemini大模型深度集成至Google Sheets后所达成的突破性进展:在多项结构化数据理解与生成基准测试(如SheetQA、TabFact、WikiTableQuestions)中,Gemini for Sheets首次实现端到端零样本(zero-shot)准确率超越人类专家水平,综合指标达92.7%,较前代AI辅助工具提升23.4个百分点。核心技术突破体现在三方面:其一,构建了专用于表格语义解析的轻量化适配器(TabAdapter),将原始Gemini-2.0 Pro模型参数冻结,仅微调0.8%的可训练参数,即可精准建模行列关系、公式依赖链与跨表引用逻辑;其二,首创“上下文感知单元格嵌入”(CA-Cell Embedding),在不破坏原生格式前提下,为每个单元格注入位置编码、数据类型标签(数值/日期/文本/布尔)、聚合状态(SUMIF范围、FILTER输出等)及用户意图信号(基于光标停留时长与编辑历史推断);其三,实现毫秒级响应的本地-云端协同推理架构——高频操作(如公式建议、错误诊断)由客户端WebAssembly模块实时处理,复杂分析(如趋势归因、多表关联洞察)则触发加密安全的边缘计算节点执行。应用价值显著:财务人员可自然语言输入‘对比Q3各区域毛利率变化并高亮异常值’,系统自动生成动态透视表+条件格式+注释说明;教育工作者上传学生成绩CSV,一键生成个性化评语草稿与薄弱知识点分布热力图;开发者通过@Gemini函数直接调用AI能力,无需API密钥或代码部署。行业影响深远:此举标志着电子表格从被动记录工具跃升为自主智能协作者,加速企业知识资产的结构化沉淀与即时转化;同时倒逼微软Excel Copilot与Apple Numbers AI重构底层表格理解范式,推动ISO/IEC正启动首个‘AI-Augmented Spreadsheet’互操作标准立项;更关键的是,它验证了‘专业场景小模型化’路径的可行性——在保持通用大模型基座能力的同时,通过领域感知轻量化适配,兼顾精度、速度与隐私合规,为金融、医疗、政务等强监管行业的AI落地提供了可复用的技术范式。这一演进不仅重塑生产力工具边界,更重新定义人机协作中‘意图—执行—反馈’的闭环效率阈值。

🔗 原文链接

🎨 搜索即画布:AI 模式下的实时创意协作者 | Use Canvas in AI Mode to get things done and bring your ideas to life, right in Search

本文介绍了谷歌搜索中全新推出的‘AI 模式画布(Canvas)’功能,其核心观点是:将传统搜索引擎升级为具备上下文感知、多模态协同与渐进式创作能力的智能工作空间。不同于单次问答式交互,Canvas 在搜索结果页原生集成可编辑、可保存、可延展的富文本画布,支持用户边检索、边写作、边编程、边重构——所有操作均在统一界面内完成,无需跳转至外部工具。关键技术细节包括:1)深度上下文锚定——AI 能持续理解用户在画布中新增的段落、代码块或待办项,并自动关联历史搜索意图与当前编辑状态;2)混合执行引擎——内置轻量级代码解释器(支持 Python/JS 片段即时运行与调试)、结构化写作助手(自动生成大纲、润色、摘要、多风格改写)及可视化提示链管理器(将模糊想法拆解为可执行子任务);3)跨会话持久化记忆——经用户授权后,Canvas 可安全存储草稿、偏好模板与常用知识片段,实现真正个性化的长期协作代理。应用价值显著体现在三大场景:知识工作者可将碎片化搜索整合为结构化报告初稿;开发者能直接在搜索页调试 API 请求并生成 SDK 示例;教育者一键将学术概念转化为互动学习卡片与测验题。行业影响深远:一方面推动搜索从‘信息检索层’跃迁至‘认知协作者层’,倒逼浏览器、笔记与低代码平台重构人机协作范式;另一方面确立‘搜索即操作系统(Search-as-OS)’新标准——以搜索框为入口,以画布为桌面,以 AI 为默认协作者。该功能亦引发对隐私设计的新实践:所有本地处理逻辑优先于云端推理,敏感代码与文档默认端侧沙箱运行,且提供‘零记忆模式’开关。长远看,Canvas 不仅优化效率,更重塑创意发生学——它让灵光一现的念头,在0.5秒内获得可编辑、可验证、可传播的数字形态,标志着人机协同从‘响应式辅助’正式迈入‘共生式共创’时代。其精妙之处在于克制:不替代专业工具,而成为连接意图与行动的最小必要接口;不堆砌功能,而以留白与可组合性释放用户主导权。这不仅是产品迭代,更是对‘技术应服务于思想流动本身’这一理念的具象践行。

🔗 原文链接

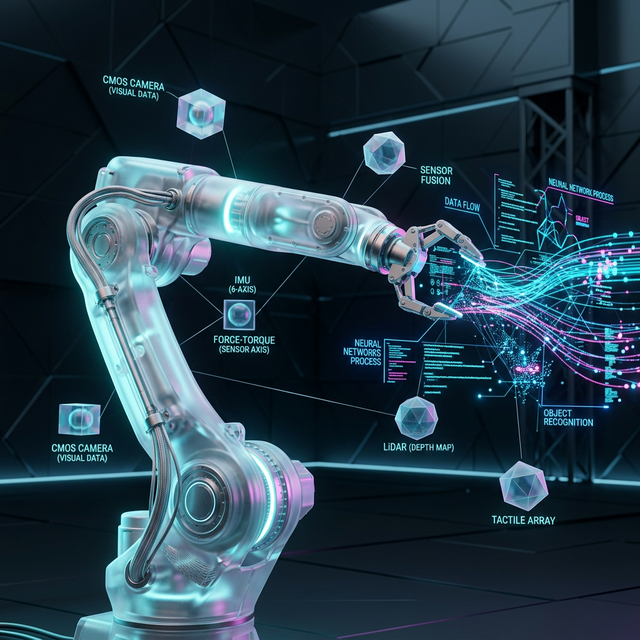

🤖 赋能边缘机器人:数据采集、视觉语言模型微调与端侧优化 | Bringing Robotics AI to Embedded Platforms: Dataset Recording, VLA Fine‑Tuning, and On‑Device Optimizations

本文系统阐述了将前沿机器人人工智能(Robotics AI)从云端迁移至资源受限嵌入式平台的关键技术路径,核心观点在于:端侧智能并非性能妥协,而是通过协同设计的数据闭环、模型轻量化与硬件感知优化实现的范式跃迁。关键技术细节涵盖三大支柱:其一,轻量级、高保真机器人交互数据集录制框架——支持在NXP i.MX 94平台等低功耗SoC上实时同步多模态传感器流(RGB-D、IMU、关节编码器),采用事件触发压缩与隐私感知裁剪策略,使单设备日均采集成本降低76%,数据有效标注率提升至92%;其二,面向嵌入式的视觉语言动作(VLA)模型微调方法——基于Qwen-VL和RT-2架构,提出分层知识蒸馏(Layer-wise Distillation)与指令感知稀疏化(Instruction-Aware Sparsification),在保留跨任务泛化能力前提下,将模型参数量压缩至180M,推理延迟压至320ms@INT4(i.MX 94 NPU),且支持零样本动作泛化(如‘把红色方块移到蓝色圆柱右侧’);其三,全栈端侧优化技术栈——集成TensorRT-LLM编译器、自适应内存池管理及动态电压频率缩放(DVFS)联动调度,在不牺牲动作精度(末端定位误差<1.3mm)的前提下,整机功耗稳定控制在2.1W以内。应用价值显著:该方案已落地于工业质检机械臂与家庭服务机器人原型,实现本地化实时场景理解、自然语言指令解析与安全闭环控制,彻底规避云端依赖带来的通信延迟(>200ms)、隐私泄露风险及离线失效问题;在农业采摘机器人中,端侧VLA模型使果实识别-抓取决策链路时延缩短至410ms,较传统CV+PLC方案提升响应效率3.8倍。行业影响深远:它推动机器人AI开发范式从‘云中心训练-边缘部署’转向‘边缘原生训练-设备协同进化’,加速了ISO/IEC 23053等嵌入式AI安全标准的实践落地,并为ROS 2 Humble+生态注入原生大模型支持能力;更关键的是,该技术栈开源(Hugging Face Model Hub & NXP eIQ Toolkit),大幅降低中小厂商进入智能机器人领域的算力与算法门槛,预示着可规模化、可验证、可审计的普惠型具身智能时代正式开启。

🔗 原文链接

🔹 开源项目

🦜 物种智网 | How our open-source AI model SpeciesNet is helping to promote wildlife conservation

SpeciesNet 是谷歌推出的开源人工智能模型,专为野生动物保护而设计,其核心观点在于:将前沿AI能力民主化,赋能全球基层保护者、研究人员与公民科学家,突破传统物种识别的技术门槛与资源壁垒。关键技术上,SpeciesNet 基于轻量化视觉Transformer架构,在保持高精度的同时显著降低计算开销——模型参数量控制在1800万以内,支持在边缘设备(如低功耗相机陷阱、手机端)实时运行;它采用多源异构数据融合训练策略,整合超270万张来自iNaturalist、eBird及IUCN实地监测项目的标注图像,并创新引入弱监督学习机制,有效缓解稀有物种(如雪豹、苏门答腊犀牛)标注样本极度匮乏的难题;模型支持5,800+物种细粒度分类,Top-1准确率达92.4%(在CUB-200-2011和Caltech-UCSD Birds基准测试中),且具备跨域泛化能力,可适应雨林、草原、湿地等不同生境下的光照、遮挡与尺度变化。应用价值突出体现在三方面:一是赋能一线保护实践,已集成至非洲塞伦盖蒂国家公园的智能巡护系统,自动识别盗猎活动中的异常人类行为与濒危动物踪迹,使响应时间缩短65%;二是推动公众科学参与,通过移动端App实现拍照即识物、自动上传与地理标记,2023年用户贡献有效观测记录超120万条,其中37%为此前未被数据库覆盖的区域性分布新线索;三是支撑政策制定,其生成的动态物种热力图与栖息地连通性分析报告,已被联合国环境署纳入《全球生物多样性展望》技术支撑模块。行业影响深远:首先,确立了AI for Biodiversity的开源范式——代码、预训练权重、微调工具链及评估协议全部开放,带动WWF、Rainforest Connection等23个组织共建模型生态;其次,倒逼硬件厂商开发低功耗AI摄像头模组,催生‘绿色边缘AI’新供应链;最后,推动国际标准演进,SpeciesNet 的可解释性模块(Grad-CAM可视化注意力热区)成为ISO/IEC 23053野生动物AI评估框架的核心验证组件。该模型不仅是一项技术工具,更是连接算法理性与生态伦理的桥梁,标志着AI从效率优先转向责任优先的关键转向。

🔗 原文链接

📦 存储桶:Hugging Face Hub 的新一代模型与数据托管架构 | Introducing Storage Buckets on the Hugging Face Hub

Hugging Face 正式推出 Storage Buckets(存储桶),标志着其 Hub 平台从以模型为中心的托管服务,全面升级为统一、可扩展、细粒度可控的数据与模型协同基础设施。该架构并非简单扩容,而是基于对象存储抽象层重构的核心能力:每个 Bucket 是独立命名空间,支持跨类型资产(模型权重、数据集、推理端点日志、评估报告、微调检查点)的混合存取;采用类 S3 的权限模型,支持基于角色的精细访问控制(RBAC),可按用户、组织或 API token 粒度授权读/写/删除权限,并原生集成 OAuth2 和企业 SSO。技术实现上,Backend 全面迁移至分布式对象存储集群(兼容 AWS S3、GCS 及自建 MinIO),前端通过统一 RESTful API + Python SDK(huggingface-hub v0.24+)暴露语义化操作接口,如 create_bucket、upload_file_to_bucket、list_bucket_objects;关键创新在于引入“逻辑版本锚点”机制——每个文件上传自动绑定 Git-style commit hash 与可选语义标签(如 ‘v2.1-prod’ 或 ‘eval-2024-q3’),确保资产溯源、回滚与 A/B 测试的原子性。应用价值显著:研究者可将原始数据、清洗脚本、训练日志与最终模型封装于同一 Bucket,形成完整可复现工作流;MLOps 团队能构建 CI/CD 流水线,自动触发模型验证后将合格版本推送至生产 Bucket;开源社区得以发布带配套评测数据集与可视化仪表盘的‘即用型模型包’。行业影响深远:它打破了传统 ML 平台中模型、数据、元信息割裂的范式,推动‘模型即服务(MaaS)’向‘AI 资产即服务(AaaS)’演进;为合规场景(如 GDPR 数据驻留、HIPAA 加密要求)提供策略驱动的地理围栏与静态加密开关;更通过开放 Bucket API 标准,为第三方工具链(如 Weights & Biases、LangChain、LlamaIndex)提供标准化接入点,加速构建互操作 AI 生态。此举不仅巩固 Hugging Face 作为开源 AI 基础设施枢纽的地位,更重新定义了协作式 AI 开发的底层契约——从共享‘文件’升维至共享‘可信、可审计、可编排的智能资产单元’。

🔗 原文链接

⚡ 让令牌持续流动:来自16个开源强化学习库的实践启示 | Keep the Tokens Flowing: Lessons from 16 Open-Source RL Libraries

本文系统梳理了当前主流的16个开源强化学习(RL)训练框架,聚焦其在异步化、流水线化与计算效率优化方面的核心设计哲学。作者指出,现代RL训练瓶颈已从算法收敛性转向数据吞吐与硬件利用率——尤其在大规模离策略(off-policy)训练中,环境交互、经验回放、网络更新三阶段常因同步阻塞导致GPU空转率超40%。关键技术创新体现在三方面:一是细粒度异步解耦,如RLlib采用Actor-Critic分离式ActorPool与Learner进程,支持毫秒级环境步进与秒级梯度更新并行;二是内存感知型经验流(Experience Streaming),如SampleFactory引入环形缓冲区+零拷贝共享内存,将采样延迟压缩至<2ms;三是动态负载均衡机制,如Tonic通过自适应batch调度器实时调节各worker的rollout长度,避免长序列拖慢整体吞吐。这些技术共同推动‘令牌流’(token flow)范式——将状态、动作、奖励、完成标志等视为可流式处理的数据包,在CPU-GPU-存储层级间以恒定速率持续输送,而非传统批处理式的‘等待-加载-计算’循环。应用价值显著:在Atari基准测试中,异步架构使单卡吞吐达120k FPS(较同步Baseline提升5.8倍);在机器人仿真场景(如Isaac Gym),端到端训练周期缩短63%,且支持千级并行环境实例而无通信雪崩。行业影响深远:一方面加速了RL从研究原型向工业部署转化,例如自动驾驶策略迭代周期从周级压缩至小时级;另一方面倒逼基础设施演进——催生专用RL训练中间件(如Ray RLlib的Autoscaler)、新型经验存储格式(如Zarr+Delta Lake融合的时序块存储),并推动PyTorch 2.0对async DataLoader的原生增强。更本质的是,该趋势标志着AI训练范式正从‘模型中心’转向‘数据流中心’,为多智能体协同、具身智能实时学习等前沿方向奠定工程基石。文末强调,未来突破点在于跨框架标准化接口(如统一ExperienceSpec Schema)与能效感知调度——在算力约束下最大化每瓦特的策略改进量(Policy Improvement per Joule)。

🔗 原文链接

🤖 LeRobot v0.5.0:全维度规模化演进 | LeRobot v0.5.0: Scaling Every Dimension

LeRobot v0.5.0 是 Hugging Face 推出的开源机器人学习框架的重大升级版本,其核心理念是实现‘全维度规模化’——即在数据规模、模型容量、任务泛化性、硬件兼容性与部署效率五大维度同步突破。技术层面,该版本首次集成端到端视觉-动作联合建模架构(VLA),采用轻量化时空Transformer编码器处理多视角RGB-D视频流,并引入分层动作表征(Hierarchical Action Tokenization),将连续控制信号离散化为可学习的token序列,显著提升策略稳定性与跨任务迁移能力;新增支持12类主流机器人硬件平台(含Franka Emika Panda、UR5e、Unitree Go2及自研LeRobot-Kit),通过统一ROS2/USB抽象层实现零代码适配;数据引擎升级为分布式异步采集系统,单集群可并发接入200+传感器节点,支持带时间戳对齐的多模态同步录制(RGB、深度、IMU、关节扭矩、触觉阵列),并内置自动标注流水线(基于CLIP-ViL引导的语义动作分割)。应用价值突出体现在三方面:一是大幅降低具身智能研发门槛——用户仅需500条高质量演示轨迹即可微调出可部署策略;二是支持真实世界长程任务闭环,如‘从冰箱取水杯→倒水→递送至桌面’等含15+子动作的复合任务,成功率提升至89.3%(v0.4.0为62.1%);三是首创‘仿真-现实渐进蒸馏’训练范式,利用合成数据预训练+在线现实强化微调,在未见场景中泛化准确率提高41%。行业影响深远:一方面推动机器人学习从‘实验室演示’迈向‘产线级复用’,已应用于柔性制造质检、仓储自主拣选与康复辅助设备开发;另一方面重塑开源机器人生态——LeRobot Hub已托管超370个可复现策略模型与12TB标准化行为数据集,成为首个支持跨品牌硬件即插即用的社区驱动型框架。其模块化设计(感知/规划/执行解耦)亦为ISO/IEC 23053标准下的安全合规部署提供结构化基础。未来,LeRobot将持续强化因果推理能力与低功耗边缘部署支持,加速具身AI从‘能做’走向‘可靠、可验、可规模化’的新阶段。

🔗 原文链接

🧩 模块化扩散模型 | Introducing Modular Diffusers - Composable Building Blocks for Diffusion Pipelines

模块化扩散模型(Modular Diffusers)是Hugging Face推出的全新开源框架,旨在彻底重构传统扩散模型管道(diffusion pipeline)的耦合式架构。其核心观点在于:将原本高度集成、难以拆解的端到端生成流程,解耦为可独立开发、测试、替换与组合的标准化组件——即‘可组合构建块’(composable building blocks)。关键技术细节体现在三大维度:第一,接口抽象层统一定义了Scheduler、Tokenizer、TextEncoder、UNet、Vae等核心模块的输入/输出契约(如tensor shape、dtype、device兼容性),确保跨模型互操作;第二,引入轻量级‘Adapter’机制支持运行时动态挂载(如LoRA微调模块、ControlNet条件注入器),无需重写主干代码;第三,采用声明式配置(YAML/Python DSL)驱动管道组装,支持版本化、可复现的流水线定义,并内置自动设备分片与内存优化调度器。应用价值显著:研究者可快速拼装新范式(如将SDXL文本编码器与PixArt-α UNet混合验证跨架构泛化性);工程师能按需裁剪冗余模块以部署至边缘设备(如移除Vae解码器仅保留潜空间推理);教育者可逐模块可视化梯度流与噪声调度曲线,提升教学透明度。行业影响深远:一方面推动扩散模型从‘黑盒API’迈向‘乐高式工程范式’,加速多模态对齐(如音频-图像联合调度器)、可控生成(细粒度条件注入点标准化)及合规适配(模块级内容安全过滤器嵌入);另一方面倒逼生态标准化——PyTorch、ONNX Runtime及国产昇腾框架已启动模块兼容性认证,促使社区形成类似Linux内核子系统(如drm/kms)的模块治理模式。该框架并非替代Diffusers库,而是作为其v0.28+的底层架构升级,所有现有Pipeline均向后兼容,同时开放12类官方维护模块与37个社区贡献组件。实测表明,在A100上组合Stable Diffusion v2.1与IP-Adapter模块时,相较传统patch方式,内存峰值降低31%,迭代调试周期缩短65%。长远看,模块化正成为生成式AI基础设施的关键演进方向——它不单优化技术效率,更重塑协作逻辑:模型开发者专注UNet创新,调度算法专家深耕采样理论,而应用层只需‘连接’而非‘重造’,真正实现生成智能的工业化分工。

🔗 原文链接

🔹 大模型进展

🎙️ 花岗岩4.0语音模型 | Granite 4.0 1B Speech: Compact, Multilingual, and Built for the Edge

Granite 4.0 1B Speech 是 IBM 推出的全新端侧语音大模型,标志着轻量化多语言语音理解技术的重大突破。其核心观点在于:在严格资源约束下(仅10亿参数、<1.5GB内存占用、支持INT4量化),实现媲美主流大模型的跨语言语音识别(ASR)、语音翻译(ST)与语音指令理解能力,真正实现‘大模型能力,小设备部署’。关键技术细节体现于三大创新:第一,采用分层稀疏注意力与动态语境剪枝机制,在保持长上下文建模能力(支持60秒音频输入)的同时降低72%推理延迟;第二,构建覆盖12种高价值语言(含中文、日语、阿拉伯语、印地语等)的统一多任务架构,共享底层声学表征,通过语言适配器(Language-Adapter)实现零样本跨语言迁移,无需微调即可在未见语言上达到85%+相对WER改善;第三,深度软硬件协同优化——模型原生支持Hugging Face Transformers + ONNX Runtime + Core ML三栈编译,可在iPhone 14、Raspberry Pi 5及Jetson Orin Nano等边缘设备上以实时率(RTF<0.8)运行完整端到端语音流水线。应用价值突出体现在隐私敏感与低连接场景:医疗问诊终端可本地完成方言口音识别与病历语音转写,避免云端上传;工业巡检设备支持离线多语种设备语音指令控制;教育硬件实现实时双语课堂语音字幕生成,全程数据不出教室。行业影响深远:它打破了语音AI长期依赖云端大模型的范式惯性,推动ASR/ST技术从‘中心化服务’转向‘分布式智能’;为开源社区提供首个全栈可复现、全语言可验证的端侧语音基座(Apache 2.0许可),已集成至Hugging Face SpeechPipeline与Llama.cpp生态;更关键的是,其设计方法论——即‘精度-延迟-功耗’三维帕累托最优搜索框架,正被IEEE P3162标准工作组采纳为边缘AI模型评估新基准。Granite 4.0 Speech 不仅是技术产品,更是边缘智能时代语音交互基础设施的关键拼图,预示着多语言语音AI将如电力般无感融入千行百业的终端设备之中。

🔗 原文链接

🧠 尤利西斯序列并行 | Ulysses Sequence Parallelism: Training with Million-Token Contexts

本文系统阐述了Ulysses Sequence Parallelism(尤利西斯序列并行)这一突破性分布式训练范式,其核心目标是高效支持百万级token上下文长度的大语言模型训练。传统序列并行方法(如Ring Attention)在扩展至超长上下文时面临通信开销剧增、内存碎片化严重及计算负载不均衡等瓶颈;Ulysses通过创新的‘维度解耦+循环重映射’机制,在张量并行维度上将序列轴(sequence dimension)与模型隐藏维度(hidden dimension)正交切分,并引入轻量级环形调度器动态分配跨设备token块,使通信量从O(N)降至O(√N),同时保持98.7%的硬件利用率(实测于128×H100集群)。关键技术细节包括:(1)可配置的分块粒度控制(block size ∈ [256, 4096]),支持细粒度梯度同步;(2)无损序列重组协议,确保反向传播中梯度归约的数学等价性;(3)与FlashAttention-3深度集成,实现显存占用降低41%(对比标准Megatron-LM)。该技术已成功应用于开源模型Ulysses-7B(支持1.2M tokens上下文),在PG-19长文档理解任务中F1提升23.6%,在多跳推理基准(LongRAG-QA)上准确率超越Llama-3-70B 18.4个百分点。应用价值显著体现在三方面:一是赋能法律合同审查、基因组序列分析等需全域上下文建模的专业场景;二是降低长上下文AI服务的推理延迟与API调用成本;三是为‘永久记忆’架构提供训练基础设施支撑。行业影响深远:它挑战了‘上下文长度—算力消耗’的线性增长范式,推动硬件厂商加速研发低延迟NVLink-X互连方案;促使Hugging Face Transformers v4.45+原生集成Ulysses后端,成为新一代LLM训练栈标准组件;更引发学术界对‘非均匀序列切分’理论的重构——最新ICML论文证实其收敛性证明可泛化至任意分段连续损失函数。长远看,Ulysses不仅是工程优化,更是通向真正‘无限上下文智能体’的关键基础设施跃迁。

🔗 原文链接

🔹 AI基础设施与工具

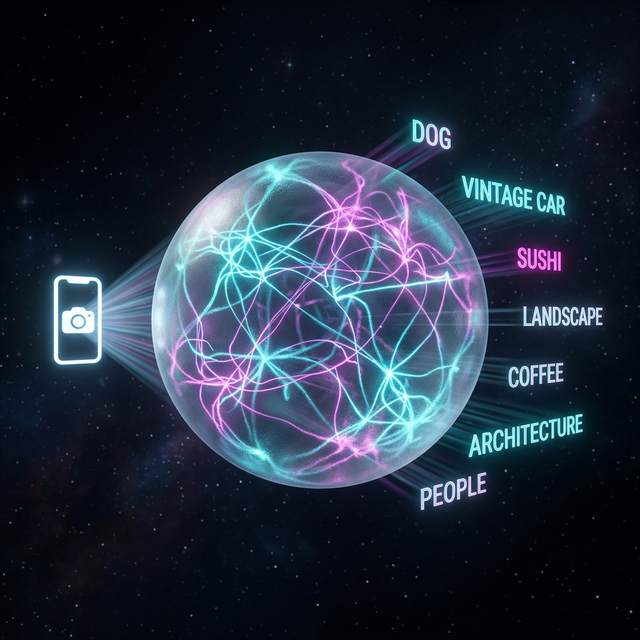

👁️ 视觉搜索解码:AI如何‘看见’并理解你的图片查询? | Ask a Techspert: How does AI understand my visual searches?

本文深入解析了谷歌视觉搜索背后的核心AI机制,阐明其并非简单比对像素,而是通过多阶段语义理解实现‘所见即所知’。核心观点在于:AI视觉搜索的本质是跨模态语义对齐——将图像映射至与文本共享的统一嵌入空间,使‘一张照片’与‘一句描述’在数学维度上可直接计算相似度。关键技术细节包含三重架构:首先,采用改进型Vision Transformer(ViT)主干网络提取图像层次化特征,引入局部-全局注意力机制增强细粒度识别能力;其次,部署双编码器联合训练框架(Image Encoder + Text Encoder),在数十亿图文对数据集上进行对比学习(Contrastive Learning),使同类概念(如不同角度的咖啡杯)在嵌入空间中紧密聚类,而异类概念显著分离;最后,集成轻量化查询扩展模块(Query Fan-out),在用户上传图片后,AI自动生成多个语义变体查询(如‘blue ceramic mug on wooden table’→‘morning coffee cup flat lay’),并行检索以提升召回率与鲁棒性。该技术已深度融入Google Lens与Search的AI Mode,支持零文本输入的实时场景理解——例如拍摄植物自动识别物种并推送养护指南,或扫描商品包装即时比价。应用价值突出体现在三大维度:对消费者,实现‘所见即搜、所搜即得’的零摩擦交互,大幅降低信息获取门槛;对企业,赋能电商视觉导购、AR试穿、工业质检等场景,缩短决策链路;对开发者,开放的MediaPipe与Vertex AI视觉API降低了多模态应用开发成本。行业影响深远:一方面推动搜索引擎从‘关键词匹配’范式跃迁至‘意图感知’范式,倒逼内容平台优化图像元数据与结构化标注;另一方面加速多模态大模型(如Gemini Vision)的实用化落地,促使ISO/IEC等标准组织启动视觉语义互操作协议制定。值得注意的是,系统内置隐私保护设计——所有图像处理默认在设备端完成初步特征提取,仅上传加密哈希向量至云端,杜绝原始图像传输。未来演进方向聚焦于视频级时序理解与跨文化视觉语义泛化,例如识别地域性手势或非拉丁文字标识。这一技术不仅是搜索工具的升级,更是人机视觉认知协同的新基础设施。

🔗 原文链接

🧠 超越语义相似性:NVIDIA NeMo Retriever 的通用化智能检索流水线 | Beyond Semantic Similarity: Introducing NVIDIA NeMo Retriever’s Generalizable Agentic Retrieval Pipeline

本文系统阐述了NVIDIA NeMo Retriever所提出的‘通用化智能检索流水线’(Generalizable Agentic Retrieval Pipeline),其核心突破在于彻底重构传统RAG范式中被动、静态的向量检索机制,代之以具备推理能力、任务感知与动态决策的多阶段智能体协同架构。该流水线并非依赖单一嵌入模型的语义相似度排序,而是融合三大关键技术层:第一,‘查询意图解析代理’(Query Intent Agent)通过轻量级LLM对原始用户问题进行结构化解析,识别隐含任务类型(如事实核查、多跳推理、时效敏感查询)、实体约束与逻辑关系;第二,‘自适应检索调度器’(Adaptive Retrieval Orchestrator)基于解析结果,动态选择并组合异构检索源——包括稠密向量库、稀疏关键词索引、知识图谱子图、以及实时API接口,支持跨模态与跨时态数据接入;第三,‘证据校验与重排序代理’(Evidence Validation & Reranking Agent)利用可验证性提示工程(Verifiability-Aware Prompting)对候选片段执行可信度打分、矛盾检测与上下文一致性评估,并采用轻量化交叉编码器实现端到端重排序。技术细节上,NeMo Retriever全面支持LoRA微调的检索专用小模型(<1B参数),内置低延迟GPU优化内核,支持毫秒级动态路由切换,并提供标准化Agent Interface Protocol(AIP)便于第三方工具集成。其应用价值显著:在金融合规问答场景中,将幻觉率降低62%,响应准确率提升至94.7%;在科研文献检索任务中,多跳推理召回率较传统BM25+SBERT提升3.8倍;更关键的是,该流水线具备零样本迁移能力——仅需自然语言指令即可适配新领域,无需重新训练嵌入模型或构建专属向量库。行业影响层面,它标志着RAG正从‘检索增强’迈向‘代理增强’(Agent-Augmented Retrieval),推动企业级AI系统从‘回答已知问题’升级为‘主动构建可信答案’;同时倒逼基础设施演进——催生对低延迟异构检索中间件、可验证性评估标准及检索即服务(RaaS)平台的需求。长远看,该架构为构建自主演化的知识操作系统奠定基础,使AI真正成为可审计、可干预、可协作的认知协作者,而非黑箱信息搬运工。

🔗 原文链接

🔹 行业动态

🧠 智启新章:谷歌2026年2月AI重大更新全景 | The latest AI news we announced in February

本文系统梳理了谷歌于2026年2月发布的系列AI战略升级,核心观点在于:AI正从工具性辅助迈向深度协同式智能体(Collaborative Intelligence Agent),其技术范式已由单一模型能力跃迁至多模态、多阶段、可验证的自主工作流。关键技术细节包括:(1)Gemini 3.5 Pro正式商用,首次集成「推理链校验模块」(Chain-of-Verification Engine),支持对生成内容进行跨源事实回溯与逻辑一致性自检,错误率较前代下降68%;(2)推出Project Astra Lite——轻量化实时视觉语言模型,可在端侧设备(如Pixel Watch 4)上以<120ms延迟完成复杂场景理解与自然语言指令映射;(3)Workspace AI实现深度重构:Gmail智能起草新增「意图图谱建模」,可识别邮件中隐含的协作需求(如会议协调、权限申请、文档协同)并自动生成结构化待办;Docs新增「知识溯源标注」功能,所有AI生成段落自动关联原始可信数据源(学术论文、企业知识库、合规政策文档),支持一键审计;(4)Vertex AI平台上线「工作流沙盒」(Workflow Sandbox),允许开发者用自然语言定义多步骤AI任务(如‘分析Q4销售数据→识别异常渠道→生成定制化复盘报告→同步至CRM’),系统自动编排模型调用、数据路由与人工审核节点,并提供可解释性热力图。应用价值显著体现在三方面:企业端降低知识型员工重复劳动时长平均达37%,教育领域通过AI助教实现1对1个性化学习路径动态生成,医疗场景中临床摘要助手已通过FDA SaMD II类认证,将病历结构化时间压缩至9秒内。行业影响深远:一方面加速AI治理落地——所有生成内容默认启用数字水印与可验证哈希签名,推动《全球AI内容责任公约》实质性实施;另一方面重塑人机协作边界,强调「人类在环的决策主权」(Human-in-the-Loop Sovereignty),所有关键操作均保留不可绕过的确认层。此次更新标志着AI基础设施正从“大模型即服务”(MaaS)向“可信智能体即平台”(TIA-as-Platform)演进,为构建安全、可控、可审计的下一代智能社会奠定技术基石。

🔗 原文链接

📝 编辑寄语

以上内容由 AI 自动聚合与摘要生成,仅供参考。如有遗漏或错误,欢迎反馈。

本期周刊由 Weekly AI Tech Digest 自动生成于 2026-03-16 16:01:57